文章

Agent Runtime 深度解析:AI 智能体的运行时架构演进

从 Observe-Think-Act 循环到分层决策架构,深入剖析 Agent Runtime 的核心设计模式、主流框架对比,以及 2026 年生产环境落地的关键挑战。

很多团队把 AI Agent 当成”带更好提示词的聊天机器人”。这个模型在生产环境中会失败。真正的 Agent 系统需要运行时决策、受控的外部动作、以及围绕每一步操作的可观测性治理。

这篇文章不讨论框架选型的功能清单,而是聚焦于一个更底层的问题:Agent Runtime 到底是什么?它解决了什么问题?为什么 2026 年被称为 Agentic Runtime 元年?

从聊天到行动:为什么需要 Runtime 层

传统 LLM 应用的交互模式很简单:

用户输入 → LLM → 输出响应这在问答场景够用了。但 Agent 要做的事情远不止聊天:它需要感知环境、调用工具、执行多步任务、处理失败、记住上下文。这时候简单的请求-响应模式就不够了。

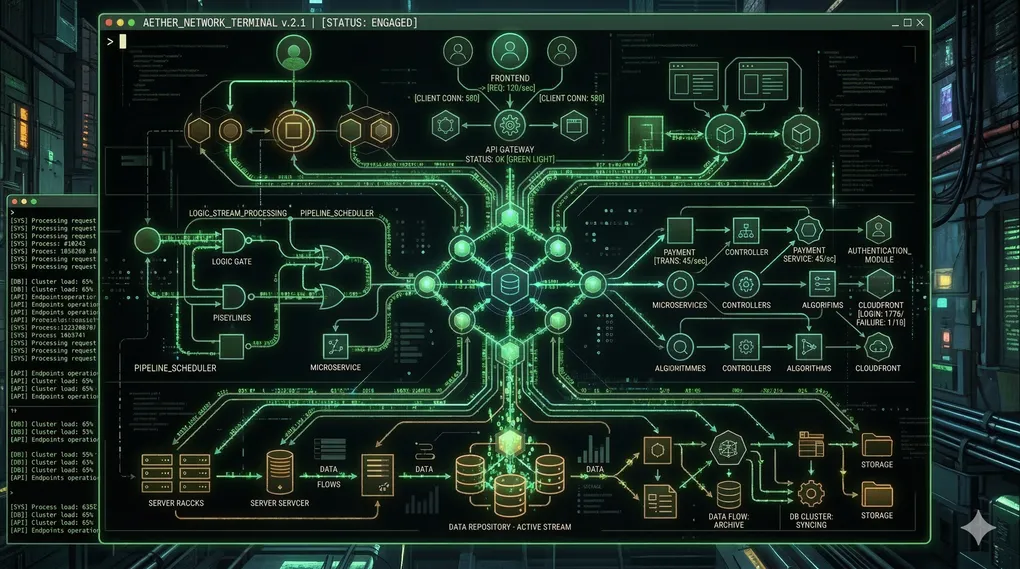

Agent 的核心循环

无论你用的是 AutoGPT、LangChain Agent、还是 Devin 风格的编码 Agent,底层都遵循同一个模式:

Observe → Think → Act → Repeat这个循环是驱动自主行为的核心引擎。Agent Runtime 的职责,就是把这个循环变成一个可管理、可观测、可控制的系统。

一个成熟的 Runtime 需要处理:

- 决策路由:是直接回复、检索知识库、调用 API、还是请求人工介入

- 状态管理:跨多轮对话保持上下文

- 执行追踪:每一步操作的完整审计日志

- 安全围栏:防止 Agent 执行危险操作

架构演进:三阶段的范式转移

Phase 1:Prompt-Based AI

User → LLM → Response特点:单次调用、无状态、无工具。适用于聊天助手、文档摘要等简单场景。

Phase 2:Orchestrated AI

User

↓

Orchestration Framework (LangChain, CrewAI)

↓

LLM + Tools + Memory

↓

Response引入了工作流编排、工具调用、多步推理。但执行仍是一次性的——输出产生后就停止了。

Phase 3:Autonomous Agent Runtime

Event / Goal

↓

Persistent Runtime Layer

↓

Planning + Reasoning

↓

Tool Execution

↓

Monitoring + Feedback

↓

(循环继续)核心差异:AI 不再是一个函数,而是一个持续运行的服务。这个持久化层就是 Agent Runtime。

Runtime 的核心组件

一个生产级 Agent Runtime 通常包含以下模块:

1. 推理层 (Reasoning Layer)

这是 Agent 的”大脑”,负责:

- 理解当前状态

- 决定下一步行动

- 选择使用哪个工具

# 伪代码:推理循环

while not goal_achieved:

observation = observe_environment()

reasoning = llm.think(observation, context)

action = decide_action(reasoning)

result = execute(action)

update_state(result)2. 工具执行器 (Tool Executor)

将 Agent 的决策转化为实际操作:

- API 调用

- 数据库查询

- 文件读写

- 外部服务集成

关键是执行契约——每个工具需要明确定义输入输出格式、权限边界、错误处理策略。

3. 状态管理器 (State Manager)

管理 Agent 的”记忆”:

- 短期记忆:当前会话上下文

- 长期记忆:持久化的知识库

- 工作记忆:任务进度、中间结果

4. 追踪与监控 (Trace & Observability)

生产环境的刚需:

- 每一步决策的可视化

- Token 消耗追踪

- 错误根因分析

- 行为审计日志

主流框架对比

LangGraph (LangChain 生态)

核心理念:图结构工作流 + 状态管理

from langgraph.graph import StateGraph

# 定义状态图

workflow = StateGraph(AgentState)

workflow.add_node("think", think_node)

workflow.add_node("act", act_node)

workflow.add_edge("think", "act")

workflow.add_edge("act", "think")优势:

- 细粒度控制,支持复杂循环

- 原生支持持久化和人工介入

- 模型无关,支持多种 LLM

适用场景:复杂业务流程、需要精确控制的场景

OpenAI Agents SDK

核心理念:轻量级多智能体编排

from openai import OpenAI

client = OpenAI()

# Agent 间交接

response = client.agents.create_and_run(

agent_id="triage_agent",

handoffs=["billing_agent", "support_agent"]

)优势:

- 内置 Tracing 和 Guardrails

- 原生支持 Agent 间交接 (Handoffs)

- 与 OpenAI 模型深度集成

局限:

- 仅支持 Python

- 与 OpenAI 生态绑定较深

Claude Agent SDK

核心理念:工具使用 + MCP 协议

from anthropic import Anthropic

client = Anthropic()

# MCP 服务器自动发现工具

response = client.messages.create(

model="claude-opus-4",

tools=mcp_tools, # 从 MCP 服务器获取

messages=[...]

)优势:

- 一流的 MCP (Model Context Protocol) 支持

- Computer Use 能力(控制桌面应用)

- Extended Thinking(展示推理过程)

适用场景:工具密集型 Agent、需要透明推理的场景

选型建议

| 场景 | 推荐框架 |

|---|---|

| 复杂工作流、企业级应用 | LangGraph |

| 快速原型、OpenAI 生态 | OpenAI Agents SDK |

| 工具驱动、MCP 集成 | Claude Agent SDK |

| 多模型支持、避免锁定 | LangGraph + 自定义 |

2026 年的关键趋势

Agent 不再是 Class,而是 Workload

Jimmy Song 在分析麦肯锡 Ark 项目时提出了一个关键洞察:2026 年将进入 Agentic Runtime 时代,Agent 不再是一个 class,而是一个 workload,需要被治理而不是被 import。

这意味着:

- Agent 需要资源配额管理

- 需要成本追踪和审计

- 需要多租户隔离

- 需要像 Kubernetes 管理 Pod 一样管理 Agent

分层决策架构

单层 Agent 的致命缺陷:当任务复杂度超过模型能力时,系统直接崩溃。

下一代架构采用三层解耦:

┌─────────────────────────────────────┐

│ 战略层 (Strategic) │

│ - 长期目标管理 │

│ - 优先级决策 │

└─────────────────┬───────────────────┘

↓

┌─────────────────────────────────────┐

│ 战术层 (Tactical) │

│ - 任务分解规划 │

│ - 子任务编排 │

└─────────────────┬───────────────────┘

↓

┌─────────────────────────────────────┐

│ 执行层 (Execution) │

│ - 工具调用 │

│ - 结果反馈 │

└─────────────────────────────────────┘语义治理成为核心

当 Agent 可以执行真实操作时,治理不再是可选项:

- 权限分级:财务 Agent 有支付权限,合规 Agent 没有联网权限

- 操作审计:每一步决策都需要可追溯

- 成本控制:防止”沉默的 Token 杀手”(Agent 陷入无意义循环)

生产落地的三大陷阱

1. 可靠性悬崖

Agent 在 Demo 中表现完美,但生产环境遇到边界情况就崩溃。

根因:测试覆盖不足。分布式系统的教训同样适用——Agent 系统不能只靠单元测试,需要生产级混沌测试。

2. 安全边界模糊

给 Agent 服务器权限让它”搞定一切”,结果是误删生产数据库。

解法:

- 最小权限原则

- 敏感操作需要人工确认

- 沙箱隔离执行环境

3. 工程化黑洞

90% 的 Agent 项目卡在”能跑 Demo”到”可运维”之间。

缺失的关键能力:

- 监控告警

- 灰度发布

- 回滚机制

- 故障恢复

实践建议

从小处开始

不要一上来就构建”完全自主”的 Agent。从低自主度的脚本化 Agent 开始,逐步提升自主等级:

- Level 1:工程师硬编码步骤,LLM 只负责内容生成

- Level 2:LLM 参与路径选择,但关键节点人工确认

- Level 3:完全自主,但有限定的操作边界

复杂度-精度矩阵

选择架构时,考虑两个维度:

- Y 轴:任务复杂度(步骤多少、推理强度)

- X 轴:精度要求(容错空间)

规则:

- 高复杂度 + 高精度(如医疗诊断):需要分层架构 + 人工介入

- 高复杂度 + 低精度(如会议纪要):Agent 黄金区间,ROI 最高

- 低复杂度 + 高精度:传统脚本足够

- 低复杂度 + 低精度:过度工程化,不值得

把 AI 当 Runtime,不是 Feature

最关键的心智转变:AI 不应该是一个”功能模块”,而应该是运行时基础设施。

这意味着:

- AI 能力需要像数据库一样被运维

- 需要 SLA、监控、灾备

- 需要考虑成本效率和资源利用率

总结

Agent Runtime 的核心价值不在于统一接口,而在于语义治理和工程范式的变革。

2026 年的竞争焦点不再是”谁的模型更聪明”,而是:

- 谁能把 AI 变成可运维的基础设施

- 谁能在保持灵活性的同时确保安全边界

- 谁能设计出既强大又可控的运行时架构

Agent 不是魔法。它是精心设计的控制循环,围绕着 LLM 推理能力构建。理解了这个核心,你就掌握了构建生产级 Agent 系统的钥匙。

讨论

留下你的想法

欢迎补充观点、指出问题,或分享与你类似的实践经验。

💬 留言评论

欢迎交流讨论,提问或分享你的想法。